本篇目录

即时通讯(IM)软件已经深度融入我们的工作与生活,其“永远在线”的特性看似理所当然,背后却隐藏着巨大的技术挑战,核心便是如何处理海量的并发连接。当用户规模从万人升级至百万人级别,传统的服务器架构会迅速崩溃。这一挑战,我们称之为从C10K到C1M的演进。本文将通过图解的方式,系统性地拆解一套能够支持百万级高并发的IM软件体系结构,揭示其在分层、解耦与技术选型上的核心设计原理,为开发者和架构师提供一套清晰、可实践的参考蓝图。

一、IM系统的核心挑战:从C10K到C1M的并发难题

要设计出卓越的架构,首先必须深刻理解其需要解决的问题。对于大规模IM系统而言,高并发是其与生俱来的技术底色,但又与常见的Web高并发有所不同。

1.1 IM场景下的高并发特殊性

- 海量长连接:不同于Web服务阅后即焚式的短连接,IM应用要求客户端与服务器之间维持长期、稳定的TCP连接。这使得服务器需要同时管理数以万计的连接,并对每一个连接的状态进行维护,资源消耗巨大。

- 瞬时消息洪峰:在群聊、企业全员广播或社会热点事件等场景下,系统可能会在极短时间内承受平日数十倍甚至上百倍的消息量。这对服务器的消息吞吐能力、处理延迟和稳定性都构成了严峻考验。

- 状态管理复杂:服务器不仅要处理消息,还必须实时维护每个用户的在线状态、设备信息、当前会话上下文等。这些“状态”信息是实现多端同步、消息准确投递的基础,也对服务器的内存管理提出了极高要求。

1.2 C10K问题:万人在线的经典门槛

C10K问题,即单台服务器如何同时处理1万个并发连接,是网络编程领域一个经典的里程碑。其本质在于,传统的“一个连接一个进程/线程”的并发模型,在连接数过万时,会因为操作系统创建、调度进程/线程的开销(尤其是上下文切换)以及巨大的内存占用而变得不可行。

为了跨越这道门槛,技术的演进主要发生在操作系统层面,通过I/O多路复用技术(如select

、poll

,以及更高效的epoll

和kqueue

)来解决。这些技术允许服务器用极少数的线程来监视和处理成千上万个连接的I/O事件,从而极大地降低了系统开销,为处理更高并发打下了坚实基础。

1.3 C1M挑战:迈向百万连接的新战场

当单机并发连接的目标从1万提升到100万(C1M)时,挑战再次升级。此时,瓶颈已经不再仅仅是I/O模型本身,而是转移到了CPU核心数、内存大小与带宽、网络协议栈的调优,乃至操作系统内核参数的极限。

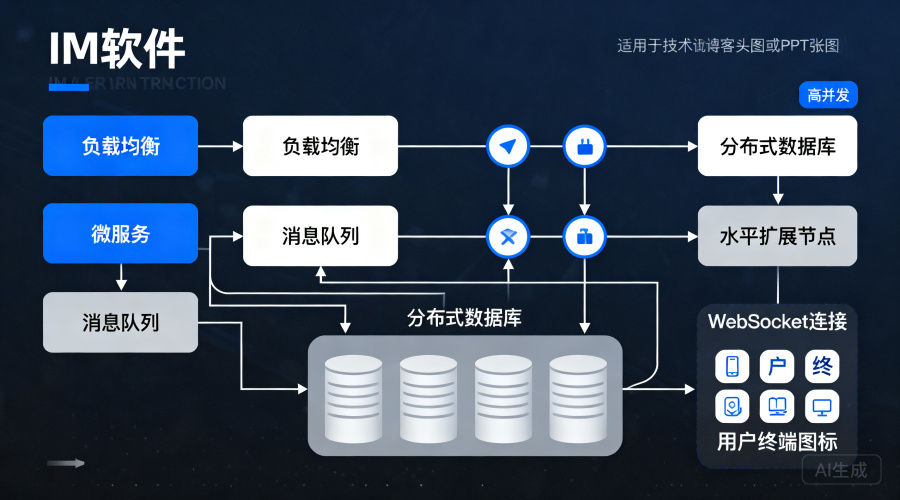

更重要的是,我们必须认识到,仅仅依靠单机层面的优化已无法有效应对C1M级别的挑战。必须从软件体系结构层面进行根本性的变革,通过分层与解耦的设计思想,将不同性质的压力分散到不同的服务集群中,这才是通往百万级并发的必由之路。

二、百万级高并发IM架构:分层与解耦的设计哲学

面对C1M的挑战,优秀的架构设计思想比任何单一的技术点都更为重要。分层与解耦,正是这套设计哲学的核心。

2.1 为什么分层解耦是关键?

- 职责分离:将一个庞大而复杂的IM系统,按照功能特性拆分为多个职责单一、边界清晰的服务层。例如,专门处理连接的层、专门处理业务逻辑的层、专门负责数据存储的层。各层只需关注自身的核心任务,降低了系统的整体复杂度。

- 独立扩展:分层之后,每一层都可以根据其自身的负载情况进行独立的水平扩展。例如,当用户连接数激增时,我们只需增加处理连接的服务器数量,而业务逻辑和数据存储层可能无需变动。这种弹性伸缩的能力是应对高并发流量的基石。

- 技术异构:分层允许我们为不同的服务层选择最适合的技术栈。我们可以用精于处理高并发I/O的语言(如Go)来构建连接层,同时用拥有成熟生态、便于快速开发业务的语言(如PHP、Java)来构建业务逻辑层。这使得我们能博采众长,让正确的技术用在正确的地方。

2.2 图解:理想的IM三层架构模型

一个理想的、支持高并发的IM系统通常可以抽象为如下的三层架构模型:

- 客户端 (Client):这是用户直接交互的界面,负责UI展示、本地数据缓存、与接入层建立长连接并进行消息的收发。它可以是PC桌面端、移动App或Web页面。

-

接入层/网关层 (Gateway Layer):这是整个架构的“咽喉”,是承载高并发的核心。

- 核心职责:维护与客户端的海量长连接、处理心跳检测、进行协议解析(如TCP、WebSocket)、消息的初步路由与转发、以及数据的加解密等。

- 设计目标:极致的轻量、高效与高并发能力。它不应处理任何复杂的业务逻辑。

-

业务逻辑层 (Business Logic Layer):这是系统的“大脑”,负责处理所有核心业务功能。

- 核心职责:处理用户登录认证、个人资料管理、好友关系链、群组管理、离线消息存储与拉取、消息审计等。

- 设计目标:保证业务逻辑的正确性、数据的可靠性和系统整体的稳定性。开发效率和可维护性是其重要考量。

这个模型通过接入层将“连接管理”和“业务处理”这两种截然不同的压力彻底分离,是实现高并发、高可用的关键所在。

三、核心解密:用Go语言打造高性能消息中转服务器

在三层架构中,接入层的设计与实现是决定系统并发能力上限的关键。Go语言凭借其独特的优势,成为了构建这一层服务的利器。

3.1 技术选型:为什么Go语言是接入层的利器?

- 天生的并发模型:Go语言在语言层面内置了协程(Goroutine)的概念。相比于操作系统层面的线程,Goroutine极其轻量,其创建和销毁的开销非常小,一个程序可以轻松创建数十万甚至上百万个Goroutine。这与IM场景下“一个连接一个处理单元”的需求完美契合,我们可以奢侈地为每个客户端连接都分配一个独立的Goroutine来处理,而无需担心资源耗尽。

- 高效的通信机制:Go语言通过“通道(Channel)”机制,提供了一种安全、简洁的协程间通信方式。它遵循“不要通过共享内存来通信,而要通过通信来共享内存”的哲学,极大地简化了并发编程的复杂性,有效避免了传统多线程编程中常见的数据竞争和死锁问题。

-

强大的标准库:Go语言拥有一个功能强大且性能卓越的标准库,特别是其

net包,使得开发者可以非常轻松地构建出高性能的TCP、UDP或WebSocket服务器,无需依赖复杂的第三方网络框架。

3.2 核心设计:海量长连接管理与消息路由

以一个采用Go语言构建的消息中转服务器为例,其内部核心工作流程大致如下:

- 连接管理:客户端发起连接请求,服务器接受连接后,会立即为其启动一个新的Goroutine。这个Goroutine的生命周期与该TCP连接绑定,专门负责监听该连接上的数据读写事件。

- 心跳维持:为了区分正常的断线和网络抖动造成的“僵尸连接”,客户端会定时向服务器发送心跳包,服务器端的Goroutine在一定时间内若未收到心跳,则会判定连接已断开,主动关闭连接并回收资源,从而维持连接池的健康。

- 消息路由:当服务器的某个Goroutine从客户端A的连接上读取到一条消息后,它不会在本地进行复杂的处理。而是根据消息头中的接收方信息(例如用户ID),将消息通过Channel发送给负责消息分发的模块,或者直接查询一个维护着“用户ID -> 连接Goroutine”映射关系的全局Map,找到代表客户端B的Goroutine,再将消息写入该Goroutine所管理的连接中,最终发送给客户端B。这个过程清晰地展示了其作为“消息中转站”的核心角色。

四、架构实践:以喧喧IM为例的体系结构解析

理论终须落地。国产企业级即时通讯与协同平台——喧喧IM,其技术架构便是上述设计思想的一次成功实践。

4.1 喧喧IM架构总览:XXC, XXD, XXB的协同作战

喧喧IM的整体架构明确地划分为三个核心部分,与我们之前讨论的三层模型一一对应:

-

XXC (客户端):即喧喧的客户端,基于

Electron + React技术栈开发,实现了对Windows、macOS、Linux等主流桌面系统的跨平台支持,为用户提供统一的交互体验。 - XXD (消息中转服务器):这正是喧喧架构中承载高并发的接入层。它采用Go语言开发,专职负责维护客户端长连接、管理文件上传下载以及高效地进行消息和信令的中转。XXD的轻量化和高性能是喧喧能够支持万人级并发的关键。

-

XXB (后端服务器):作为业务逻辑层,XXB使用

PHP + MySQL技术栈,并基于禅道软件自研的ZentaoPHP框架进行开发。它承载了用户管理、组织架构、权限控制、离线消息、应用扩展等所有业务逻辑和数据持久化工作。

喧喧IM的这套架构,完美印证了分层解耦、技术异构的设计哲学。它将性能敏感、状态化的连接管理(XXD)与业务复杂、相对无状态的逻辑处理(XXB)彻底分开,使得两部分可以独立演进和扩展。

4.2 为企业而生:私有化部署与信创支持

这套分层架构不仅带来了高性能,更在企业级应用场景中展现出独特的价值。

- 架构与私有化:喧喧IM的核心价值之一是支持私有化部署。其分层架构使得整套系统可以轻松地部署在企业的内部服务器中。XXB和数据库掌握着企业的核心业务数据,完全置于内网保护之下,实现了数据的自主可控,从根本上杜绝了公有云IM可能存在的数据泄露风险。

- 架构与安全性:在私有化部署的基础上,喧喧IM的架构还支撑了多重安全机制。例如,通讯全程加密、数据库消息加密存储、IP登录限制等功能,都在XXD和XXB的协同下实现,为企业信息安全构建了坚实的防护体系。

- 架构与信创:解耦的架构使其具备极强的适应性和灵活性。喧喧IM全面适配国产化软硬件生态,包括麒麟、统信UOS等国产操作系统,以及鲲鹏、飞腾、申威等国产CPU。这种能力正是得益于其清晰的架构分层,使得针对不同底层环境的适配工作可以聚焦于特定层面,而不会影响整个系统的稳定性,充分满足了国企、军政等单位对信息技术应用创新的要求。

4.3 开放与扩展:构建一体化信息平台

一个现代化的IM系统不应是信息孤岛。喧喧IM的架构设计同样考虑了未来的开放与扩展能力。

- API与集成:作为业务中心的XXB,通过提供丰富的开放API接口,可以方便地与企业现有的OA、ERP、CRM等信息系统进行集成。这使得喧喧IM可以作为统一的消息中枢,将各个系统产生的通知、待办等信息聚合起来,推送给相关人员。

- Webhook与机器人:喧喧IM还支持Webhook和机器人机制。开发者可以轻松创建机器人,将代码提交、服务器告警、自动化构建等信息推送到指定的聊天群组中,实现高效的ChatOps,这同样得益于其业务层(XXB)良好的扩展性设计。

五、常见问题 (FAQ)

Q1: 为什么喧喧的后端(XXB)使用PHP,而不是和XXD一样用Go语言?

这是一个典型的技术选型权衡(Trade-off)的结果。XXD的核心诉求是极致的并发性能和对网络I/O的高效处理,Go语言的协程模型是应对这一挑战的最佳选择。而XXB的核心职责是处理复杂多变的业务逻辑,例如组织架构管理、权限系统、应用集成等。PHP语言拥有庞大成熟的开发生态、极高的开发效率,以及像ZentaoPHP这样为企业级应用量身打造的框架,更适合业务功能的快速开发与迭代。职责分离的设计让两部分都能选用最适合自身场景的技术栈,发挥各自的最大优势。

Q2: 部署一套支持高并发的IM系统,对服务器硬件有什么要求?

硬件配置与预期的并发用户量直接相关,没有一刀切的标准。以喧喧IM为例,官方给出的参考建议是:对于5000人以下的企业,承载XXD和XXB的服务器均推荐采用8核CPU、16GB以上内存的配置。硬盘和带宽则更多地取决于企业内部文件、图片、音视频等非结构化数据的使用频率和大小。私有化部署的一大优势就在于,企业可以完全根据自身的实际规模和使用强度,灵活地配置和调整硬件资源,避免浪费。

Q3: IM系统如何保证消息一定被对方收到?(消息ACK机制)

这通常是通过ACK(Acknowledge,确认)机制来实现的,这是一个“收-发-确认”的闭环流程:

- 发送方将消息发送给服务器(如XXD)。

- 服务器收到消息后,将其转发给接收方所在的客户端。

- 接收方的客户端成功收到消息后,会向服务器回复一个ACK确认包。

- 服务器收到这个ACK后,就可以确信消息已成功投递,此时可以将该消息标记为“已送达”,并可以通知发送方。如果在设定的超时时间内服务器仍未收到接收方的ACK,则会认为投递失败,此时可以根据策略进行重试,或者将该消息转为离线消息处理。

Q4: 用户不在线时,消息如何处理?(离线消息机制)

离线消息处理是IM系统不可或缺的功能,其流程如下:

- 当消息中转服务器(XXD)尝试向目标用户投递消息,但发现该用户当前没有任何活动的在线连接时,它不会丢弃这条消息。

- XXD会将这条消息转交给后端业务服务器(XXB)。

- XXB接收到消息后,会将其存入数据库中,并关联上目标用户的ID,将其标记为“离线消息”。

- 当该用户下一次登录时,其客户端(XXC)在完成登录认证后,会主动向XXB发起一个请求,拉取所有属于自己的离线消息。XXB从数据库中查询并返回,从而实现消息的最终同步。

Q5: 这种三层架构未来如何进行水平扩展?

这种分层解耦的架构天生就具备良好的水平扩展能力:

- 扩展接入层 (XXD):当用户连接数持续增长,单台XXD服务器达到瓶颈时,可以简单地增加更多的XXD服务器实例。在这些XXD服务器的前端,通常会部署一个负载均衡器(如LVS、Nginx或硬件F5),由它负责将客户端的连接请求均匀地分发到后端的不同XXD实例上。

- 扩展业务层 (XXB):当业务请求的QPS(每秒查询率)增大,导致单台XXB服务器压力过大时,同样可以部署多个XXB实例构成集群。由于XXB处理的HTTP请求大多是无状态的,因此可以通过负载均衡器将请求分发到任意一台XXB服务器上。更深层次的,其依赖的数据库也可以通过读写分离、分库分表等技术进行扩展,以应对更大规模的数据压力。

261

261

联系我们

联系我们

社群交流

社群交流